实践:用Ollama+DeepSeek-R1搭建AI知识库

去年年末DeepSeek突然大火,横扫科技圈,给世界带来震撼。特别是R1的深度思考能力,用过的都知道,令人又惊又叹。DS这次的爆火,是中国科技圈默默卧薪尝胆的结果,不得不佩服中国技术人的颠覆能力。

ChatGPT在2023年初爆发的时候,只是有点惊讶和兴奋,用了一波,后续没怎么追踪了。但DS的爆发,我也不得不重新正视AI这波科技发展浪潮,顺势而为,用Ollama+DeepSeek结合某公司对外的用户帮助文档,构建起AI知识库。三月初的时候已经搞好了,但一直没有在公司推广,因为存在一些不可抗力的因素。最主要的,整体搭建的成本还是较高,除了财大气粗的央国企和知名互联网企业,一般做业务的公司,业务增长是最优先考虑的,基本很少会舍得花大价钱去投入对主要业务增长收益甚微的技术实践,这是最基本的现实。单台高配的服务器当然能支撑起AI知识库的运行,但是高并发下,容易卡顿、超时甚至无法回应。即使做出来,用户体验不好,效果也将差强人意。加机器当然能解决问题,但又回到了前面所说的最基本现实的困境。

说这么多,还是回到实践上来。

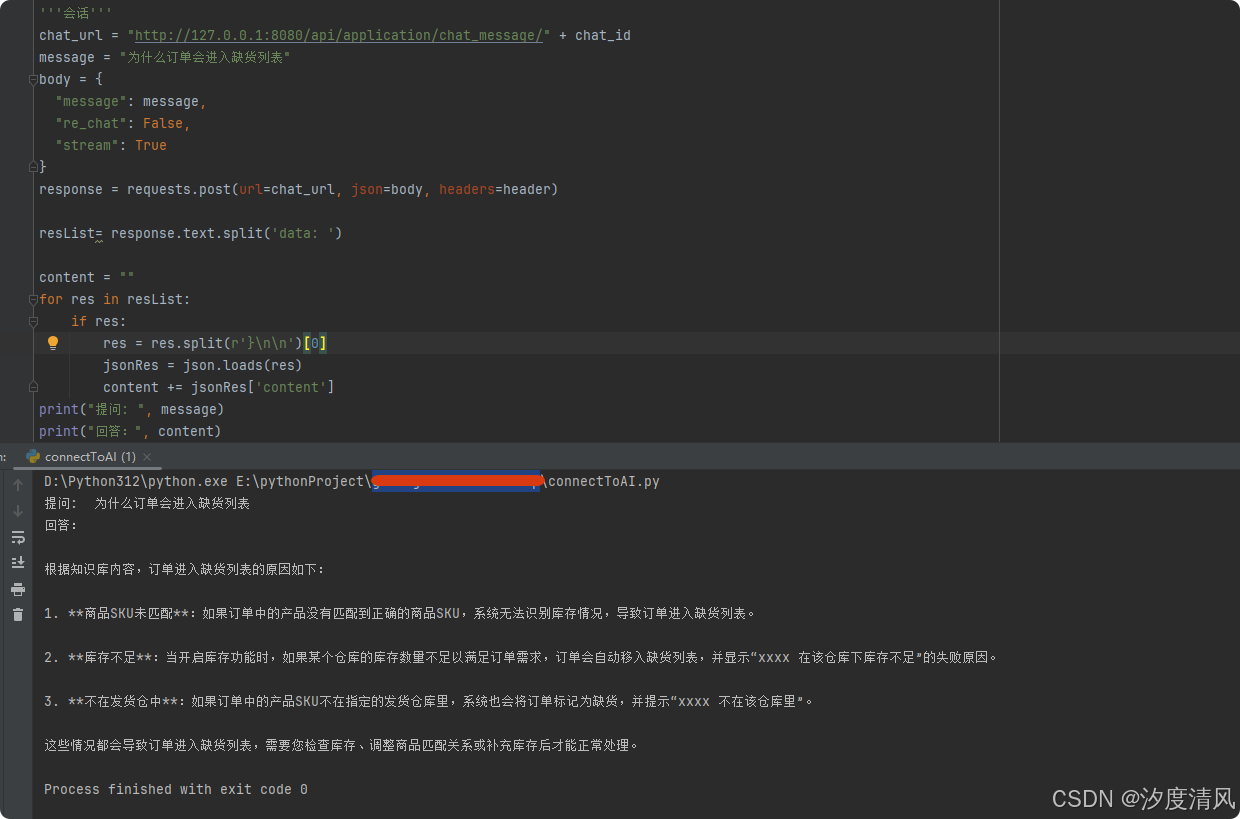

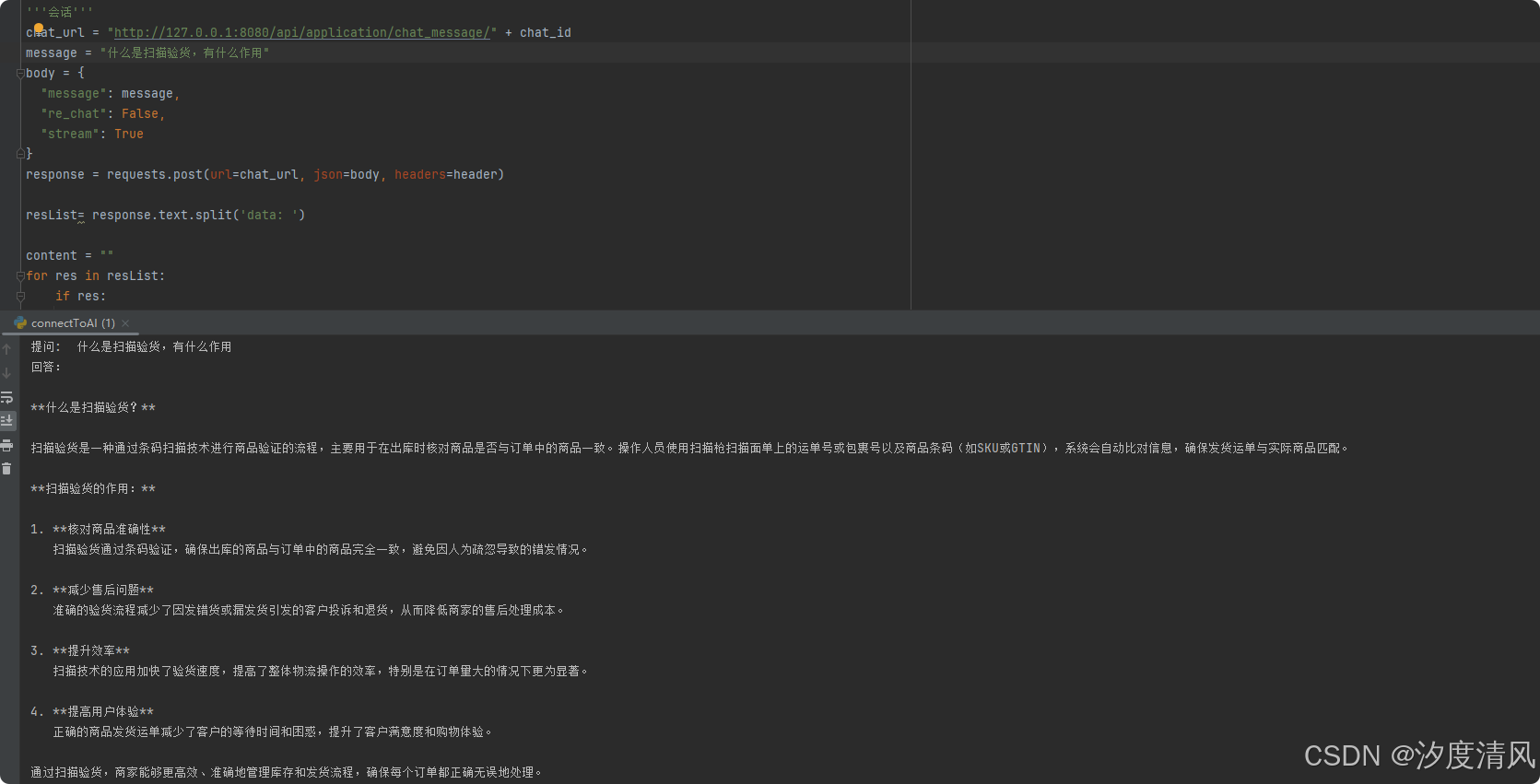

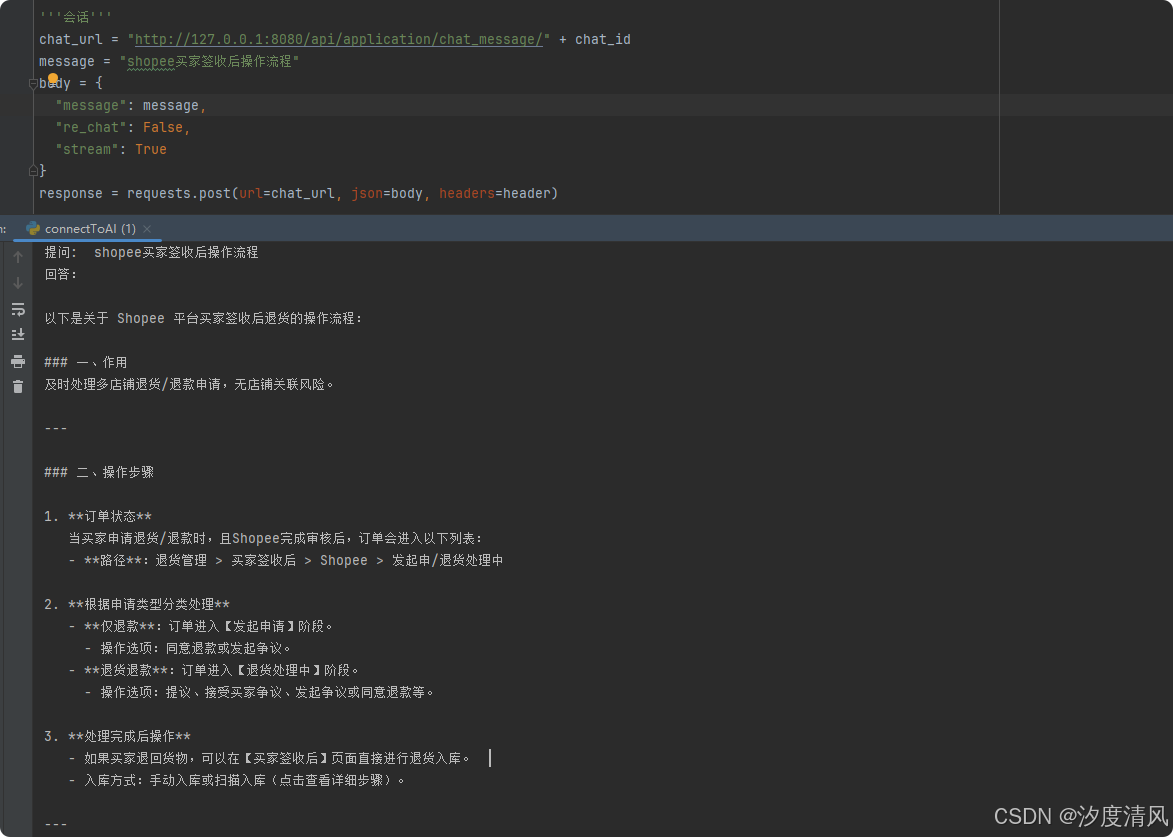

以下罗列了三个场景,通过数据训练和调参后,调用API接口,得到的回答精准度和质量都非常高,DS是在原有的知识库基础上,自己总结和归纳,DS的推理能力是非常棒的。DS对于中文和英文支持程度极高,但对于其他语种支持力度比较弱,这也能理解,毕竟发源于中国。

**

场景一:

**

**

场景二:

**

**

场景三:

**

Ollama+DeepSeek网上的教程也比较多,这里就不阐述了。动动手,还是会有成果的。