[Dify] 使用 Docker 本地部署 Dify 并集成 Ollama 模型的详细指南

在 AI 应用快速发展的今天,开源项目如 Dify 正成为构建本地化 AI 应用的利器。通过 Dify,你可以轻松地集成不同的大语言模型(LLM),如 Ollama,并快速创建可交互的 AI 应用。本篇文章将带你一步步通过 Docker 在本地部署 Dify,并完成 Ollama 模型的集成配置。

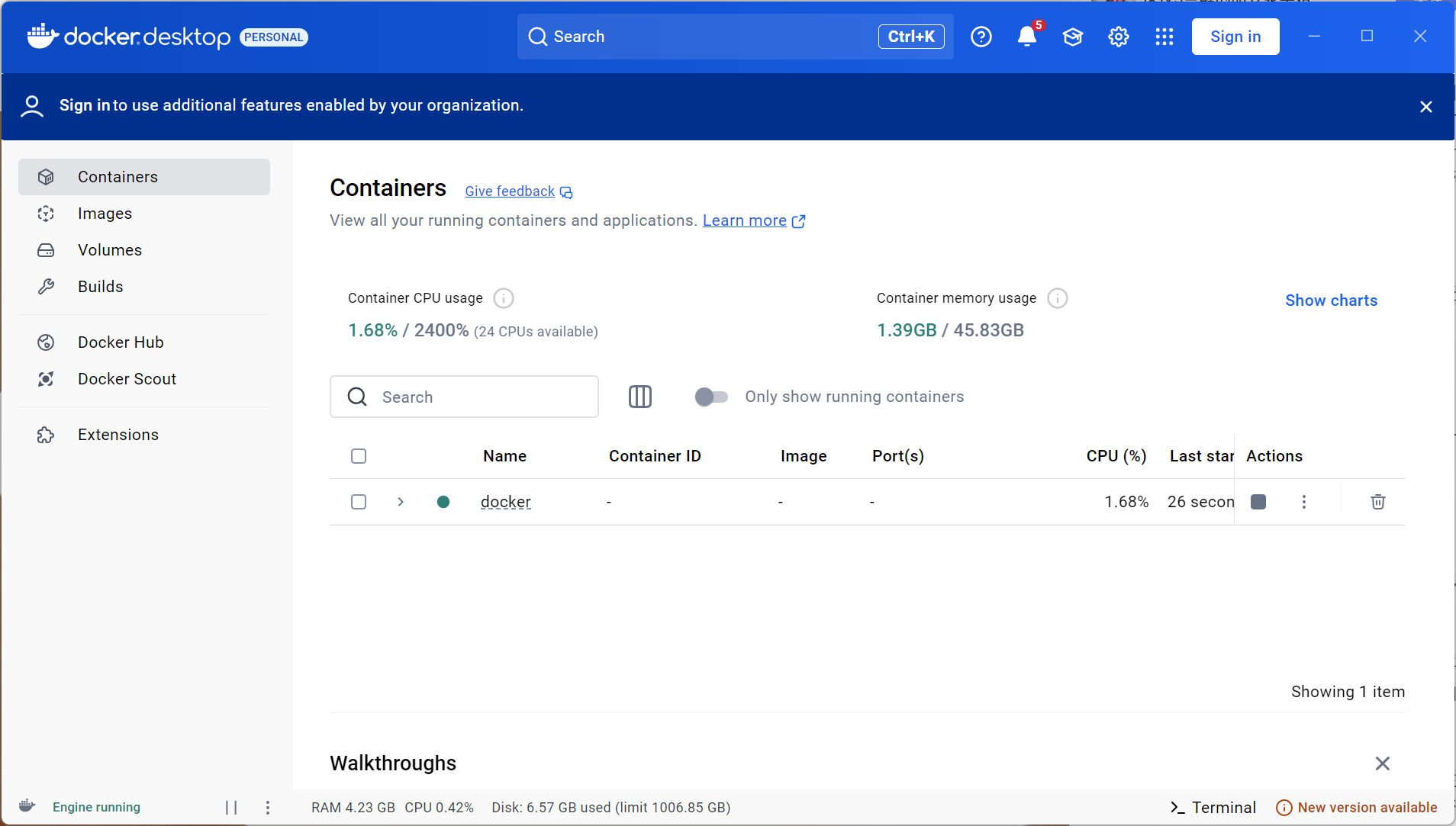

一、准备工作:安装 Docker

在正式部署前,需要先确保本地环境已安装好 Docker。

-

可前往 Docker 官网 下载适合你系统的 Docker Desktop;

-

安装完成后,打开终端(Windows 用户可使用 CMD 或 PowerShell)执行

docker -v,验证是否成功安装。

二、获取并解压 Dify 项目文件

-

打开 <