g1:基于 Llama,用提示工程实现类似 o1 的深度推理

开源项目 g1 利用巧妙的提示策略,在 Groq 硬件上使用 Llama-3.1 70b 模型实现了类似 OpenAI o1 的推理链能力。g1 将推理过程可视化,并结合多种技巧引导 LLM 进行深度思考,显著提升了其在逻辑问题上的准确率,为 LLM 推理能力的提升提供了新的开源方案。

OpenAI 提出的 o1 模型,通过大规模强化学习和思维链技术,实现了强大的推理能力,甚至能够解决一些博士级别的复杂问题,成为 LLM 推理领域的标杆。然而,o1 模型的训练成本高昂,且内部细节并未公开,限制了其应用和研究。

g1 项目横空出世:开源 Llama 叫板 o1

g1 项目的出现为 LLM 推理能力的提升提供了新的思路,也为开源 LLM 模型带来了新的希望。g1 是一个开源项目,旨在通过提示策略来增强 LLM 的推理能力,使其能够像 o1 模型一样进行逐步推理,解决复杂的逻辑问题。g1 项目选择 Llama 作为基础模型,试图证明即使是开源模型,在合适的引导下也能展现出强大的推理能力。

g1 的目标与定位

g1 项目的目标是探索如何利用提示策略来提高 LLM 的推理能力,并激发开源社区开发新的策略来产生类似 o1 的推理能力,推动 LLM 推理技术的发展。g1 的定位是一个实验性的原型,旨在展示在可视化步骤中提示推理的强大功能,而不是与使用不同技术的 o1 进行比较或完全复制。

g1 与 o1 的区别

g1 和 o1 在实现方式上存在一些关键区别:

- • 训练方法: o1 模型使用大规模强化学习进行训练,以使用思维链进行推理,而 g1 则主要依靠提示策略来引导 LLM 进行推理,无需额外的训练过程,大大降低了使用门槛。

- • 模型: g1 使用开源的 Llama-3.1-70b-versatile 模型,而 o1 模型的内部细节并未公开,这使得 g1 项目更容易被复现和研究。

- • 透明度: g1 展示所有推理步骤,提高了透明度,使用户可以清楚地了解 LLM 的思考过程,而 o1 模型的推理过程是一个黑盒,不利于研究人员理解其工作原理。

g1 工作原理:提示策略引导推理链

g1 的核心思想是利用精心设计的提示词来引导 LLM 进行逐步推理,就像人类思考问题一样,将复杂的问题分解成多个简单的步骤,逐步解决。

逐步推理:分解问题,各个击破

在 g1 中,LLM 会将推理过程分解成多个步骤,每个步骤都有一个标题和相应的内容。例如,在解决“草莓中有多少个 R?”这个问题时,g1 可能会将推理过程分解为以下步骤:

- \1. 识别问题:确定问题是询问草莓单词中字母“R”的数量。

- \2. 分解单词:将“strawberry”分解成单个字母:s、t、r、a、w、b、e、r、r、y。

- \3. 计数字母“R”:统计字母列表中“R”出现的次数。

- \4. 得出结论:草莓单词中有两个“R”。

动态思维链:根据需要调整推理步骤

在每个步骤中,LLM 可以选择继续进行另一个推理步骤,或提供最终答案。这种动态思维链机制使得 LLM 能够根据问题的复杂程度和自身推理能力,灵活地调整推理步骤的数量和内容,展现出类似人类的思考过程。

提示词分解:揭秘 g1 的魔法咒语

g1 的提示词包含 LLM 人设设定、推理步骤指导、JSON 格式要求和一系列最佳实践提示。

g1 的完整提示词及注解:

You are an expert AI assistant that explains your reasoning step by step.

// 为 LLM 设定角色,使其扮演专家级的 AI 助手,并强调需要逐步解释推理过程。For each step, provide a title that describes what you're doing in that step, along with the content.

// 指导 LLM 将推理过程分解成多个步骤,每个步骤都需要有标题和内容描述。Decide if you need another step or if you're ready to give the final answer.

// 要求 LLM 自主决定是否需要继续推理或给出最终答案,体现动态思维链的特性。Respond in JSON format with 'title', 'content', and 'next_action' (either 'continue' or 'final_answer') keys.

// 规定 LLM 的输出格式为 JSON,包含标题、内容和下一步行动(继续或给出最终答案)。USE AS MANY REASONING STEPS AS POSSIBLE. AT LEAST 3.

// 鼓励 LLM 使用尽可能多的推理步骤,至少 3 步,以保证推理过程的深度和完整性。BE AWARE OF YOUR LIMITATIONS AS AN LLM AND WHAT YOU CAN AND CANNOT DO.

// 提醒 LLM 注意自身作为语言模型的局限性,避免给出超出能力范围的答案。IN YOUR REASONING, INCLUDE EXPLORATION OF ALTERNATIVE ANSWERS.

// 要求 LLM 在推理过程中探索不同的答案,避免思维定势,提高答案的准确性。CONSIDER YOU MAY BE WRONG, AND IF YOU ARE WRONG IN YOUR REASONING, WHERE IT WOULD BE.

// 引导 LLM 进行自我反思,思考推理过程中可能出现的错误,提高推理的严谨性。FULLY TEST ALL OTHER POSSIBILITIES. YOU CAN BE WRONG.

// 强调 LLM 需要充分考虑所有可能性,并承认自身可能犯错,避免给出过于自信的答案。WHEN YOU SAY YOU ARE RE-EXAMINING, ACTUALLY RE-EXAMINE, AND USE ANOTHER APPROACH TO DO SO. DO NOT JUST SAY YOU ARE RE-EXAMINING.

// 要求 LLM 在重新检查推理过程时,要真正进行反思,并尝试不同的方法,避免流于形式。USE AT LEAST 3 METHODS TO DERIVE THE ANSWER.

// 鼓励 LLM 使用至少 3 种方法来推导答案,从多个角度验证答案的正确性。USE BEST PRACTICES.

// 要求 LLM 遵循最佳实践,例如使用清晰的语言、合理的逻辑等,提高推理过程的可读性和可理解性。Example of a valid JSON response:

json

{"title": "Identifying Key Information", "content": "To begin solving this problem, we need to carefully examine the given information and identify the crucial elements that will guide our solution process. This involves...", "next_action": "continue"

}

g1 效果展示:逻辑问题迎刃而解

g1 在解决一些简单的逻辑问题上表现出色,例如草莓问题和数字比较问题,证明了其提示策略的有效性,也展现了 Llama 模型的潜力。

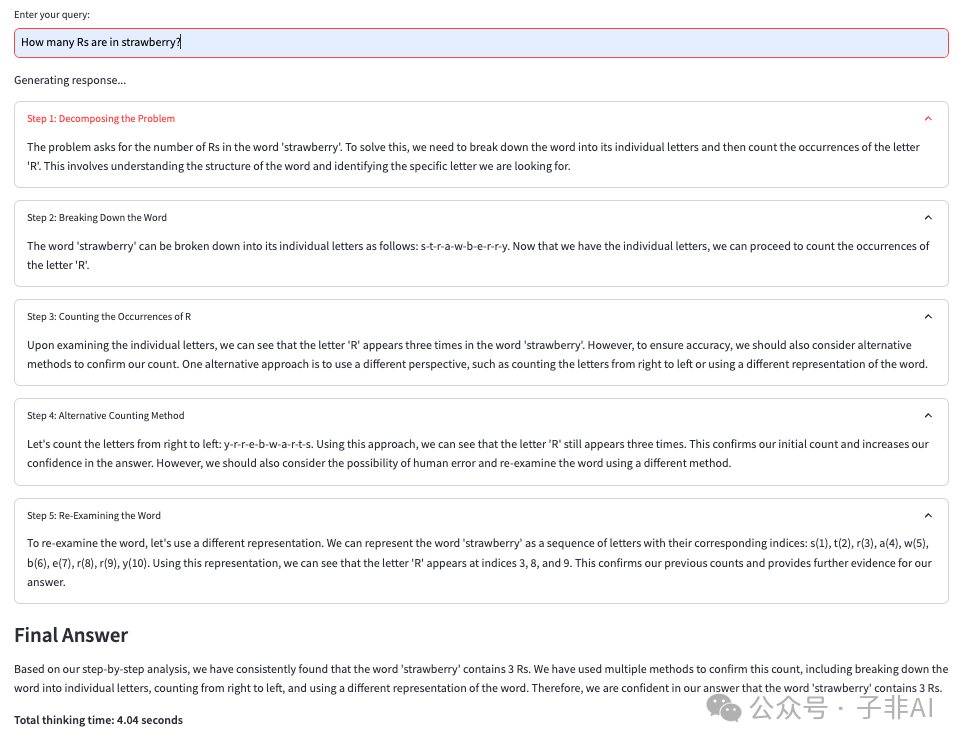

草莓问题:LLM 不再被字母“R”难倒

在草莓问题(“草莓中有多少个 R?”)上,g1 的准确率达到约 70%,远超未经提示的 Llama-3.1-70b (0%) 和 ChatGPT-4o (30%)。这表明 g1 的提示策略能够有效地引导 LLM 克服其局限性,并最终解决问题。

g1 解决草莓问题的推理过程:

草莓示例

草莓示例

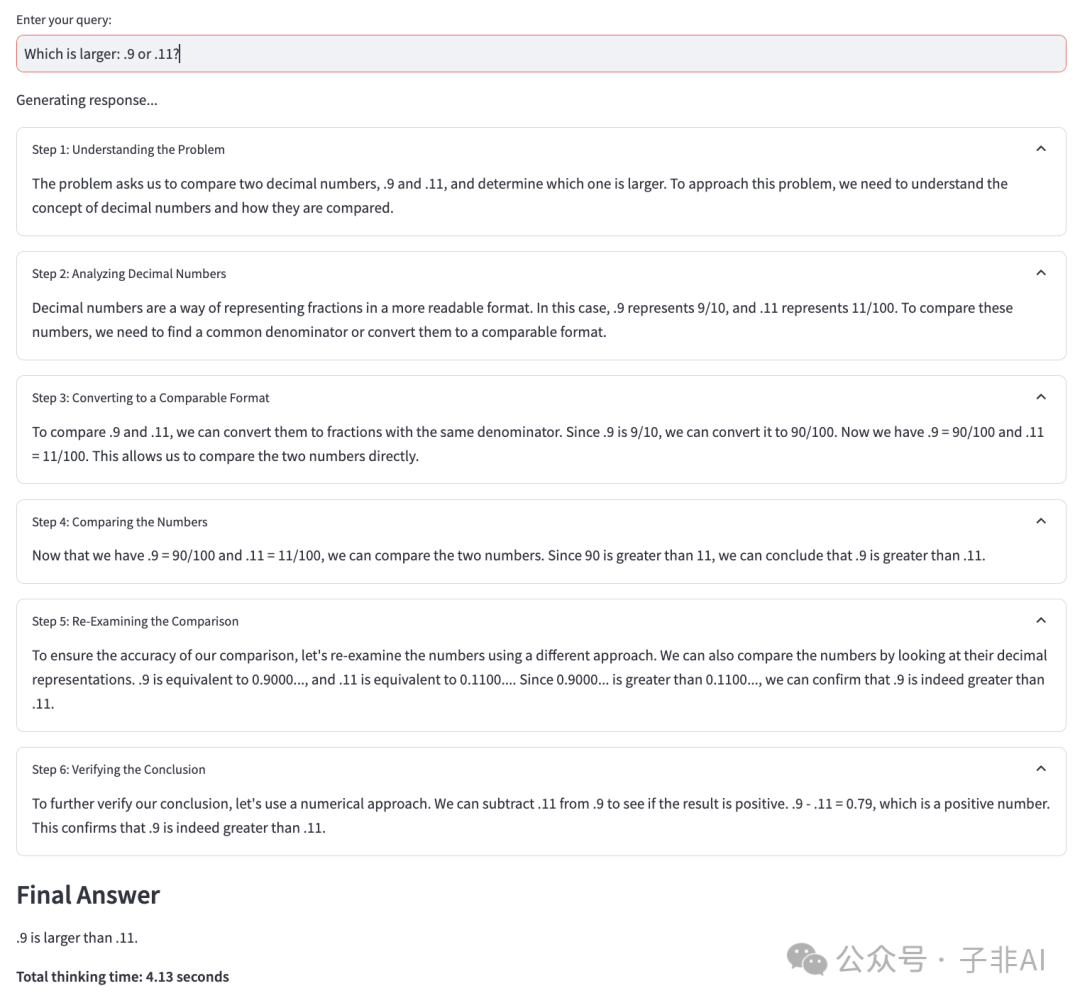

数字比较:轻松识别大小关系

g1 也能够解决一些简单的数字比较问题,例如“哪个更大,.9 还是 .11?”。

g1 解决数字比较问题的推理过程:

0.9 或 0.11 示例

0.9 或 0.11 示例

g1 核心代码解读:基于 Streamlit 的 UI 实现

g1 项目使用 Streamlit 构建用户友好的交互界面,方便用户体验 g1 的推理能力。

API 调用与错误处理

def make_api_call(messages, max_tokens, is_final_answer=False):# 尝试三次调用 API for attempt in range(3): try: # 调用 Groq API 获取 LLM 响应 response = client.chat.completions.create( model="llama-3.1-70b-versatile", # 使用的模型 messages=messages, # 消息列表 max_tokens=max_tokens, # 最大 token 数 temperature=0.2, # 温度系数 response_format={"type": "json_object"} # 响应格式 ) # 将 JSON 格式的响应转换为 Python 字典并返回 return json.loads(response.choices[0].message.content) except Exception as e: # 如果三次尝试都失败,则返回错误信息 if attempt == 2: if is_final_answer: return {"title": "Error", "content": f"Failed to generate final answer after 3 attempts. Error: {str(e)}"} else: return {"title": "Error", "content": f"Failed to generate step after 3 attempts. Error: {str(e)}", "next_action": "final_answer"} # 等待 1 秒后重试 time.sleep(1)

代码解释:

make_api_call 函数负责调用 Groq API 获取 LLM 的响应。

响应生成与步骤控制

def generate_response(prompt):# 定义消息列表,包含系统角色、用户角色和助手角色的初始消息 messages = [ {"role": "system", "content": "You are an expert AI assistant that explains your reasoning step by step... USE BEST PRACTICES."}, # 省略部分提示词内容,完整内容请参考上文 {"role": "user", "content": prompt}, # 用户输入的提示 {"role": "assistant", "content": "Thank you! I will now think step by step following my instructions, starting at the beginning after decomposing the problem."} # 助

手角色的初始回复] steps = [] # 存储推理步骤的列表 step_count = 1 # 推理步骤计数器 total_thinking_time = 0 # 总思考时间 while True: start_time = time.time() # 记录开始时间 step_data = make_api_call(messages, 300) # 调用 API 获取推理步骤内容 end_time = time.time() # 记录结束时间 thinking_time = end_time - start_time # 计算思考时间 total_thinking_time += thinking_time # 累加总思考时间 # 将推理步骤添加到 steps 列表 steps.append((f"Step {step_count}: {step_data['title']}", step_data['content'], thinking_time)) # 将助手角色的回复添加到 messages 列表 messages.append({"role": "assistant", "content": json.dumps(step_data)}) # 判断是否到达最终答案或超过最大推理步骤数 if step_data['next_action'] == 'final_answer' or step_count > 25: break step_count += 1 # 使用 yield 关键字逐个返回推理步骤,方便 Streamlit UI 实时更新 yield steps, None # 生成最终答案 messages.append({"role": "user", "content": "Please provide the final answer based on your reasoning above."}) start_time = time.time() final_data = make_api_call(messages, 200, is_final_answer=True) end_time = time.time() thinking_time = end_time - start_time total_thinking_time += thinking_time steps.append(("Final Answer", final_data['content'], thinking_time)) yield steps, total_thinking_time

代码解释:

generate_response 函数负责生成 LLM 的响应,并控制推理步骤。

g1 的创新点:可视化与提示工程的完美结合

可视化推理链:增强透明度,建立信任

g1 将 LLM 的推理过程可视化,使用户能够清晰地了解 LLM 的思考过程,并更容易理解其最终答案是如何得出的。这种透明度在以往的 LLM 应用中是比较少见的,它有助于增强用户对 LLM 的信任,并促进 LLM 技术的进一步发展。

仅通过提示工程提升推理能力:简单高效,普适性强

g1 没有采用复杂的强化学习方法来训练 LLM,而是仅通过精心设计的提示词来引导 LLM 进行推理。这表明,即使不进行额外的训练,也可以通过提示工程来显著提升 LLM 的推理能力。这种方法更加简单易行,并且可以应用于各种不同的 LLM 模型,具有很强的普适性,也为开源 LLM 模型的发展提供了新的方向。

总结

g1 项目展示了提示策略在提升 LLM 推理能力方面的巨大潜力,也证明了开源 LLM 模型在推理任务上具有竞争力。g1 的开源特性和可视化推理链也为 LLM 技术的透明度和可解释性做出了贡献,有利于 LLM 技术的推广和应用。未来,g1 项目可以进一步探索更复杂的提示策略,以解决更具挑战性的推理问题。

相关链接

- • g1 项目 GitHub 仓库: https://github.com/bklieger-groq

如何学习AI大模型?

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。