人工智能通识速览一(神经网络)(编辑中)

上篇:人工智能通识速览一(机器学习)

人工智能通识速览一(机器学习)(编辑中)-CSDN博客![]() https://blog.csdn.net/siper12138/article/details/146512068?sharetype=blogdetail&sharerId=146512068&sharerefer=PC&sharesource=siper12138&spm=1011.2480.3001.8118

https://blog.csdn.net/siper12138/article/details/146512068?sharetype=blogdetail&sharerId=146512068&sharerefer=PC&sharesource=siper12138&spm=1011.2480.3001.8118

目录

二、神经网络

1.参数优化

1.1.梯度下降及其变体

1.1.1 随机梯度下降(SGD):

1.1.2 带动量的随机梯度下降(Momentum SGD):

1.1.3 Adagrad:

1.1.4 Adadelta:

1.1.5 RMSProp:

1.1.6 Adam:

1.2 学习率调整策略

固定学习率:

学习率衰减:

自适应学习率调整:

1.3 正则化技术

1.4 二阶优化方法

2.经典的神经网络

2.1. 感知机(Perceptron)

2.2 多层感知机(Multilayer Perceptron, MLP)

二、神经网络

- 定义2:神经网络通常指人工神经网络(Artificial Neural Networks,ANNs),是一种模仿动物神经网络行为特征,进行分布式并行信息处理的算法数学模型。它是受到人类大脑结构启发而诞生的一种算法,通过调整内部大量节点之间相互连接的关系来处理信息。

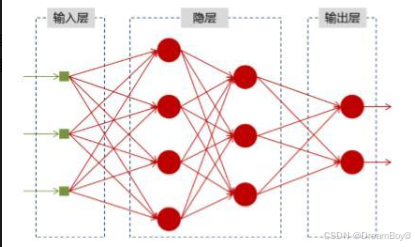

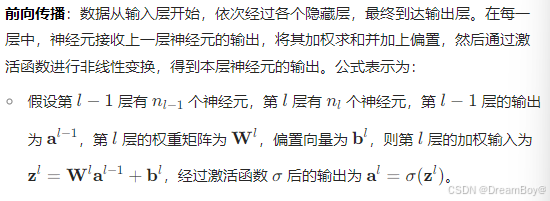

- 基本结构3:神经网络由输入层、一个或多个隐藏层和输出层组成。输入层接收外部数据,隐藏层对数据进行处理和特征提取,输出层给出最终的处理结果。数据从输入层进入,经过隐藏层的层层处理,最终从输出层输出。每个层由多个神经元组成,神经元之间通过带有权重的连接相互传递信息。

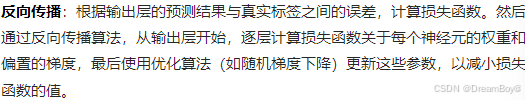

- 工作原理1:每个神经元接收来自其他神经元的输入,并将这些输入进行加权求和,再通过一个激活函数进行处理。如果输出值超过给定阈值,神经元将被激活,并将数据传递到下一层。神经网络通过调整神经元之间连接的权重来学习数据中的模式和规律,这个过程通常使用反向传播算法来实现。在训练过程中,根据预测结果与真实标签之间的差异,反向传播算法会计算出每个权重的梯度,并更新权重,使得网络的预测结果逐渐接近真实值。

- 类型1:包括前馈神经网络,数据仅沿一个方向从输入流向输出,是最常见的类型;卷积神经网络,常用于图像识别、模式识别和计算机视觉等领域,利用卷积操作提取图像特征;循环神经网络,具有反馈循环,适用于处理时间序列数据,如股票市场预测、自然语言处理中的文本生成等。

- 应用4:在计算机视觉领域,可用于图像识别、目标检测、图像分割等,如自动驾驶汽车中的视觉识别、面部识别系统等;在语音识别领域,能将语音信号转化为文字,用于虚拟助手、自动转录软件等;在自然语言处理领域,可实现文本分类、情感分析、机器翻译、问答系统等功能;还可用于推荐系统,根据用户的行为和偏好进行个性化推荐。

1.参数优化

神经网络的参数优化技术旨在调整神经网络中的参数,以最小化损失函数,提高模型的性能和泛化能力。以下是一些常见的参数优化技术:

1.1.梯度下降及其变体

1.1.1 随机梯度下降(SGD):

每次迭代使用一个小批量的数据来计算梯度并更新参数。它的计算速度快,但梯度估计可能存在噪声,导致收敛过程有波动。通过调整学习率等超参数,可以在一定程度上控制收敛速度和稳定性。

1.1.2 带动量的随机梯度下降(Momentum SGD):

引入动量概念,将过去的梯度信息进行累积,以加速收敛并减少振荡。可以理解为在参数更新时,不仅考虑当前的梯度,还考虑之前的梯度方向,使参数更新具有一定的惯性,能够更快地朝着最优方向移动。

1.1.3 Adagrad:

自适应地调整每个参数的学习率,根据参数的历史梯度信息来调整学习率的大小。对于频繁更新的参数,学习率会逐渐变小;对于不常更新的参数,学习率会相对较大。这样可以在训练过程中自动调整不同参数的学习速度,适用于不同特征具有不同尺度的数据集。

1.1.4 Adadelta:

是 Adagrad 的改进版本,它通过使用一个移动窗口来计算梯度的平方和,而不是像 Adagrad 那样累积所有历史梯度的平方和,从而避免了学习率过度衰减的问题。同时,Adadelta 不需要手动设置学习率,具有更好的自适应能力。

1.1.5 RMSProp:

与 Adadelta 类似,也是通过对梯度的平方进行指数加权平均来调整学习率。它能够有效缓解 Adagrad 中学习率急剧下降的问题,在处理非平稳目标函数时表现较好,常用于循环神经网络(RNN)等模型的训练。

1.1.6 Adam:

结合了 Momentum 和 RMSProp 的优点,不仅能够自适应地调整学习率,还利用了动量来加速收敛。它对不同的参数分别进行自适应更新,同时能够处理非平稳目标函数和稀疏梯度问题,是目前应用较为广泛的一种优化算法。、

1.2 学习率调整策略

学习率(Learning Rate)是机器学习和深度学习中一个至关重要的超参数,它在模型训练过程中起着控制模型参数更新步长的关键作用

固定学习率:

在整个训练过程中使用固定的学习率。这种方法简单,但可能无法在不同的训练阶段都达到最佳的收敛效果。通常需要通过多次试验来选择合适的固定学习率。

学习率衰减:

随着训练的进行,逐渐降低学习率。常见的衰减方式有线性衰减、指数衰减、余弦退火衰减等。例如,指数衰减按照一定的指数规律降低学习率,能够在训练前期快速收敛,后期逐渐减小学习率以避免错过最优解。

自适应学习率调整:

根据模型的训练情况自动调整学习率。例如,当损失函数在一定步数内没有明显下降时,降低学习率;或者根据验证集上的性能指标来调整学习率。这种方法能够更灵活地适应不同的训练情况,但也需要更多的计算资源和时间来监控和调整学习率。

1.3 正则化技术

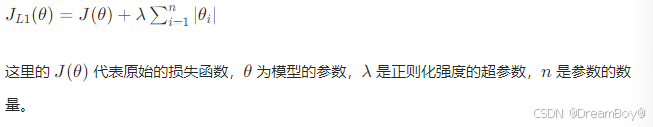

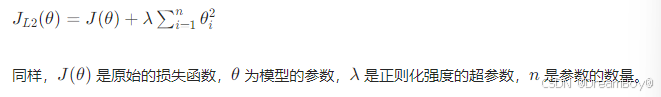

L1 和 L2 正则化:

在损失函数中添加正则化项,用于惩罚模型的复杂度。

L1 正则化会使模型的参数变得稀疏,即一些参数的值会变为 0,从而实现特征选择的效果;

L2 正则化通过惩罚参数的平方和,使参数的值尽量小,能够防止模型过拟合,提高模型的泛化能力。

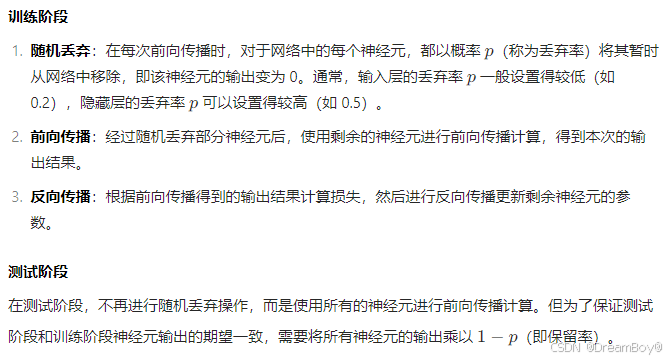

Dropout:在训练过程中随机丢弃一部分神经元及其连接,以减少神经元之间的协同适应,防止模型过拟合。Dropout 可以看作是一种数据增强技术,每次训练时都相当于从原始数据中采样出不同的子网络进行训练,从而提高模型的鲁棒性和泛化能力。

1.4 二阶优化方法

牛顿法:

利用目标函数的二阶导数(海森矩阵)来确定参数的更新方向,能够更快地收敛到最优解。然而,计算海森矩阵及其逆矩阵的计算成本较高,并且在高维空间中可能存在数值稳定性问题,因此在大规模神经网络训练中较少直接使用。

拟牛顿法:

如 BFGS、L - BFGS 等算法,通过近似海森矩阵或其逆矩阵来避免直接计算二阶导数,降低了计算复杂度。这些方法在一些小规模问题或特定场景下可能表现较好,但在处理大规模神经网络时,由于内存需求和计算量仍然较大,也不是主流的优化方法。

2.经典的神经网络

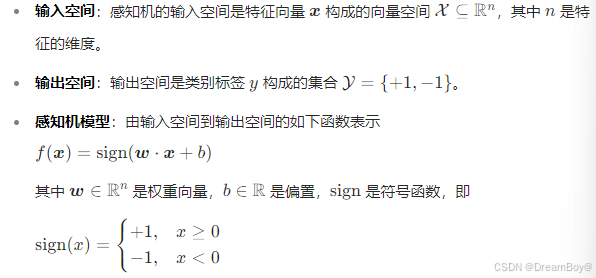

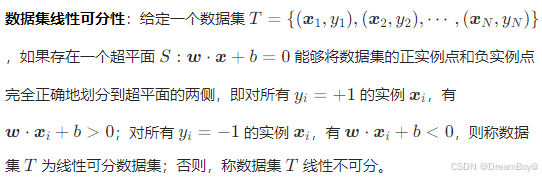

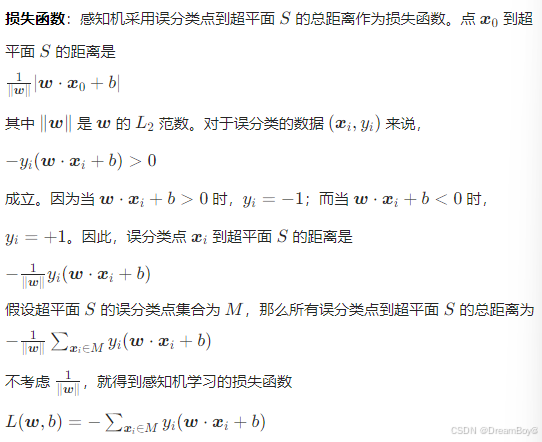

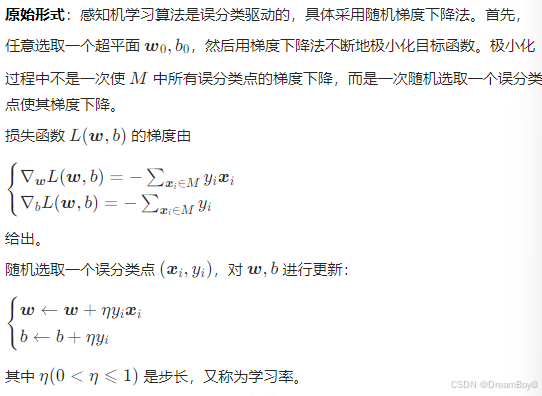

2.1. 感知机(Perceptron)

简介:是最简单的神经网络形式,由美国学者弗兰克・罗森布拉特在 1957 年提出。它是一种二分类的线性模型,可看作是一个具有单层神经元的前馈神经网络。

结构:包含输入层和输出层,输入层接收外界信息,输出层根据输入信息进行加权求和并通过激活函数(如阶跃函数)进行处理,最终输出分类结果。

学习策略

应用:早期用于图像识别、字符识别等简单的模式识别任务,虽然其功能有限,但为后续神经网络的发展奠定了基础。

2.2 多层感知机(Multilayer Perceptron, MLP)

简介:在感知机的基础上增加了隐藏层,形成了多层结构,能够处理更复杂的非线性问题,是一种前馈神经网络。

结构:由输入层、一个或多个隐藏层和输出层组成,层与层之间通过全连接的方式连接,即前一层的每个神经元与后一层的每个神经元都有连接,信息从输入层依次向前传播到输出层,在传播过程中通过激活函数对神经元的输出进行非线性变换。

工作原理:

应用:广泛应用于各种领域,如数据分类、回归分析、语音识别、图像识别等,是许多其他复杂神经网络模型的基础。

2.3 #激活函数#

激活函数:引入非线性因素,使多层感知机能够学习复杂的非线性关系。常见的激活函数有:

Sigmoid 函数

特点:其函数图像是一条 S 形曲线,能将任意实数映射到(0,1)区间,输出值可看作概率,常用于二分类问题的输出层。它具有平滑、可导的优点,但存在梯度消失问题,当输入值过大或过小时,梯度趋近于 0,导致训练速度慢,且输出不以 0 为中心,会影响权重更新。

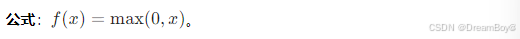

ReLU 函数(Rectified Linear Unit)

特点:计算简单,收敛速度快,能有效缓解梯度消失问题。在输入大于 0 时,梯度恒为 1,使神经元更容易被激活。但它也有缺点,如训练时可能出现神经元死亡的情况,即某些神经元在训练过程中一直输出 0,不再更新权重。

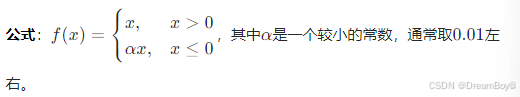

Leaky ReLU 函数

特点:是 ReLU 函数的改进版,解决了 ReLU 函数在负半轴神经元死亡的问题。当x为负数时,Leaky ReLU 函数有一个较小的斜率α,使神经元在负半轴也能有一定的激活程度,从而避免神经元完全死亡。

Tanh 函数(Hyperbolic Tangent)

特点:函数图像关于原点对称,输出值范围在(−1,1)之间,与 Sigmoid 函数形状相似,但克服了 Sigmoid 函数输出不以 0 为中心的问题。不过,它同样存在梯度消失问题,在深层网络训练中可能导致收敛困难。

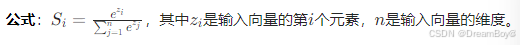

Softmax 函数

特点:常用于多分类问题的输出层,能将输入向量转换为表示各个类别的概率分布的输出向量,输出向量的每个元素都在(0,1)之间,且所有元素之和为 1。通过 Softmax 函数,可以得到每个类别被预测为正例的概率,从而进行分类决策。

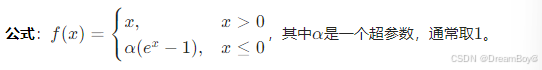

ELU(Exponential Linear Unit)函数

特点:ELU 函数结合了 ReLU 函数和 Leaky ReLU 函数的优点,既能够在正半轴保持线性,又在负半轴具有指数形式的平滑过渡。它可以使神经元的输出均值更接近0,有助于加快训练速度,并且在一定程度上缓解了梯度消失问题。同时,由于其在负半轴的取值范围是[−α,0),可以避免神经元在训练过程中出现死亡的情况。

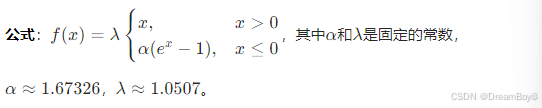

SELU(Scaled Exponential Linear Unit)函数

特点:SELU 函数是在 ELU 函数的基础上进行了缩放,具有自归一化的特性。在使用 SELU 函数的神经网络中,如果满足一定的条件,网络在训练过程中能够自动保持输入数据的均值为0,方差为1,这有助于减少梯度消失和梯度爆炸的问题,使得深层神经网络的训练更加稳定和高效。

Swish 函数

特点:Swish 函数是一种平滑的、非单调的激活函数,它结合了 Sigmoid 函数的非线性特性和线性函数的一些优点。具有无上界有下界、平滑、非单调等性质,在一些深度学习任务中表现出了较好的性能,能够提高模型的泛化能力和训练速度。与 ReLU 函数相比,Swish 函数在负半轴也有一定的取值,不会像 ReLU 那样直接将负半轴的值置为0,从而能够更好地利用输入信息。

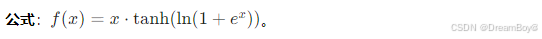

Mish 函数

特点:Mish 函数是一种新型的激活函数,它具有连续可微、非单调等特性。Mish 函数在深层神经网络中表现出了较好的性能,能够提高模型的准确率和泛化能力。与 ReLU 函数和 Swish 函数相比,Mish 函数在不同的数据集和模型结构上可能具有更好的适应性,尤其在处理复杂的图像和语音等数据时,能够更好地提取特征,减少模型的过拟合现象。

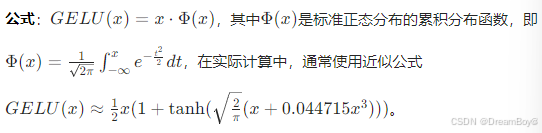

GELU(Gaussian Error Linear Unit)函数

特点:GELU 函数是一种基于正态分布的激活函数,它根据输入值的概率分布来调整神经元的输出。与 ReLU 等激活函数相比,GELU 函数能够更好地对输入信息进行建模,尤其在处理具有不确定性的输入数据时表现出更好的性能。它具有平滑、连续可微的特点,能够使神经网络的训练更加稳定,在自然语言处理等领域的一些大型模型中得到了广泛应用。

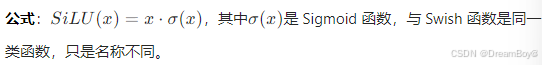

SiLU(Sigmoid - weighted Linear Unit)函数

。

。

特点:SiLU 函数结合了线性函数和 Sigmoid 函数的特性,具有平滑的非线性变换能力。它在不同的深度学习任务中都表现出了较好的性能,能够自适应地调整神经元的输出,根据输入的大小来决定是更接近线性变换还是更强烈的非线性变换,有助于模型更好地学习数据的内在特征,提高模型的表达能力。

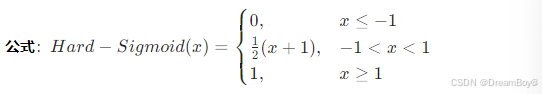

Hard - Sigmoid 函数

特点:Hard - Sigmoid 函数是 Sigmoid 函数的一种近似形式,它通过分段线性函数来逼近 Sigmoid 函数。与 Sigmoid 函数相比,Hard - Sigmoid 函数的计算更加简单高效,不需要进行指数运算,因此在一些对计算资源和速度要求较高的场景中具有优势,如在嵌入式设备或移动设备上的深度学习模型中可能会被采用。不过,由于它是分段线性的,其平滑性不如 Sigmoid 函数,可能会在一定程度上影响模型的性能,但在某些情况下可以通过适当的模型调整来弥补。

Hard - Swish 函数

特点:Hard - Swish 函数是 Swish 函数的一种近似形式,类似于 Hard - Sigmoid 函数与 Sigmoid 函数的关系。它通过简单的线性运算和取最大值操作来近似 Swish 函数,计算复杂度较低,适合在资源受限的环境中使用。同时,它也保留了 Swish 函数的一些优点,如在一定程度上能够自适应地调整神经元的激活程度,对模型的性能有一定的提升作用,在一些轻量级的深度学习模型中表现出了较好的效果。

2.4 卷积神经网络(Convolutional Neural Network, CNN)

简介:专门为处理具有网格结构数据(如图像、音频)而设计的神经网络,由福岛邦彦在 20 世纪 80 年代提出,在 2012 年 AlexNet 取得巨大成功后得到了广泛关注和应用。

结构:包含卷积层、池化层和全连接层等。卷积层通过卷积核在数据上滑动进行卷积操作,提取数据的局部特征;池化层对卷积层的输出进行下采样,减少数据维度,同时保留重要特征;全连接层则将池化层的输出进行分类或回归等操作。

应用:在图像识别、目标检测、语义分割等计算机视觉领域取得了巨大的成功,也在自然语言处理等其他领域有一定的应用。

AlexNet

简介:2012 年由 Alex Krizhevsky 等人提出,在当年的 ImageNet 大规模视觉识别挑战赛(ILSVRC)中取得了显著胜利,其 top - 5 错误率比第二名低了 10.8 个百分点,推动了深度学习在计算机视觉领域的复兴。

模型结构:它是一个 8 层的卷积神经网络,包含 5 个卷积层和 3 个全连接层,使用了 ReLU 激活函数,首次引入了数据增强、Dropout 等技术来防止过拟合,还使用了局部响应归一化(LRN)层来提高模型的泛化能力。

影响和应用:证明了深度卷积神经网络在大规模图像分类任务上的强大能力,为后续的深度学习模型发展奠定了基础,启发了一系列更深层次、更复杂的神经网络架构的出现,推动了计算机视觉领域的快速发展。

VGGNet

简介:2014 年由牛津大学的 Visual Geometry Group 提出,在 ILSVRC 竞赛中取得了优异成绩,其网络结构简洁且具有很强的扩展性,加深网络层数后性能有显著提升。

模型结构:主要特点是使用了多个较小卷积核(如 3×3)的卷积层来代替较大卷积核的卷积层,通过不断堆叠这些小卷积核的卷积层来增加网络的深度,同时使用了多个全连接层进行特征分类,网络结构规整,易于实现和理解。

影响和应用:VGGNet 的结构简单且高效,为后来的深度学习模型设计提供了一种有效的范式,即通过增加网络深度来提高模型性能。其预训练模型在许多计算机视觉任务中被广泛用作特征提取器,具有很好的通用性和迁移学习能力。

GoogLeNet(Inception - v1)

简介:2014 年由谷歌公司的 Christian Szegedy 等人提出,在 ILSVRC 竞赛中获得冠军,其创新的 Inception 模块大大提高了网络的性能,同时减少了模型的参数数量。

模型结构:引入了 Inception 模块,该模块通过并行使用不同大小的卷积核和池化操作,能够捕捉不同尺度的图像特征,有效地提高了网络对图像特征的提取能力。此外,网络中还使用了全局平均池化层来代替全连接层,进一步减少了模型的参数数量,降低了过拟合的风险。

影响和应用:开创了使用多尺度卷积核并行提取特征的先河,为后续的模型设计提供了新的思路。其 Inception 模块被广泛应用于各种计算机视觉模型中,推动了计算机视觉领域对网络结构设计的创新和发展。

ResNet

简介:2015 年由何恺明等人提出,解决了随着神经网络层数增加而出现的梯度消失和退化问题,使得训练极深的神经网络成为可能,在 ILSVRC 竞赛中取得了重大突破。

模型结构:引入了残差连接(Residual Connection),通过将输入直接跳过一些层连接到后面的层,使得网络可以学习残差函数,有效地缓解了梯度消失问题,同时也使得网络能够更好地训练和优化。

影响和应用:ResNet 的提出极大地推动了深度学习在计算机视觉以及其他领域的发展,使得训练非常深的神经网络成为常态,为后续各种高性能模型的发展提供了基础,许多先进的模型都借鉴了残差连接的思想。

YOLO(You Only Look Once)

简介:2015 年由 Joseph Redmon 等人提出的一种目标检测算法,它将目标检测任务看作是一个回归问题,直接从图像中预测出目标的类别和位置,大大提高了目标检测的速度。

模型结构:将输入图像划分为 S×S 的网格,每个网格负责预测 B 个边界框和这些边界框的置信度,以及 C 个类别概率。网络结构简单,由卷积层和全连接层组成,能够快速地对图像进行处理,实现实时的目标检测。

影响和应用:YOLO 开创了基于深度学习的单阶段目标检测算法的先河,为实时目标检测提供了一种有效的解决方案。在安防监控、自动驾驶、机器人视觉等需要快速检测目标的领域有广泛应用,并且启发了一系列后续的单阶段目标检测算法的发展。

循环神经网络(Recurrent Neural Network, RNN)

简介:具有记忆功能的神经网络,能够处理序列数据,如文本、语音等。它的神经元之间存在反馈连接,使得网络能够对之前的信息进行记忆和利用,从而更好地处理序列中的长期依赖关系。

结构:由输入层、隐藏层和输出层组成,隐藏层的神经元在每个时间步都会接收当前的输入和上一个时间步的隐藏状态,并根据这些信息更新当前的隐藏状态,然后输出结果。常见的 RNN 变体有长短期记忆网络(LSTM)和门控循环单元(GRU)。

应用:在自然语言处理领域的语言建模、机器翻译、文本生成等任务,以及语音识别、时间序列预测等领域有广泛应用。

长短期记忆网络(Long - Short Term Memory, LSTM)

简介:是一种特殊的循环神经网络(RNN),由 Sepp Hochreiter 和 Jürgen Schmidhuber 于 1997 年提出,能够有效地处理序列数据中的长期依赖问题。

模型结构:LSTM 的核心是记忆单元,它可以选择性地记住和遗忘信息。通过输入门、遗忘门和输出门来控制信息的流动,能够更好地捕捉序列中的长期依赖关系,避免了传统 RNN 中梯度消失和爆炸的问题。

应用:在自然语言处理中,广泛应用于语言建模、机器翻译、文本生成等任务;在语音识别中,用于对语音序列进行建模,提高识别准确率;在时间序列预测中,能够根据历史数据预测未来趋势。

门控循环单元(Gated Recurrent Unit, GRU)

简介:也是一种循环神经网络,由 Kyunghyun Cho 等人于 2014 年提出,是 LSTM 的一种变体,具有更简单的结构,同时也能有效地处理序列数据中的长期依赖问题。

模型结构:GRU 主要包含更新门和重置门,更新门用于控制前一时刻的状态信息有多少被保留到当前时刻,重置门用于控制对过去信息的遗忘程度。通过这两个门来调节信息的流动,从而实现对长期依赖关系的建模。

应用:与 LSTM 类似,在自然语言处理、语音识别、时间序列预测等领域有广泛应用,由于其结构相对简单,计算效率较高,在一些对实时性要求较高的任务中表现出色。

Transformer

简介:2017 年由 Ashish Vaswani 等人提出,最初用于机器翻译任务,它摒弃了传统的循环神经网络(RNN)和卷积神经网络(CNN),完全基于注意力机制,能够并行计算,大大提高了训练效率,并且在处理长序列数据时表现出了强大的能力。

模型结构:由编码器和解码器两部分组成,编码器负责将输入序列编码成一个固定长度的向量表示,解码器则根据编码器的输出和之前生成的输出序列来生成下一个输出。其中,注意力机制是 Transformer 的核心,通过计算输入序列中每个位置与其他位置之间的关联程度,自适应地分配权重,从而更好地捕捉文本中的长程依赖关系。

应用:在自然语言处理领域引发了重大变革,不仅在机器翻译中取得了显著的成果,还广泛应用于文本生成、问答系统、文本分类等各种自然语言处理任务中。此外,在计算机视觉等其他领域也开始得到应用和推广,如视觉 Transformer(ViT)将 Transformer 应用于图像分类任务,取得了很好的效果。

高效注意力机制改进版

FlashAttention:通过优化 GPU 内存的使用来减少内存读写次数,使 Transformer 在处理长文本序列时更快且更节省内存,训练速度更快且能处理更长文本序列,提升了模型性能。

显式稀疏 Transformer(Explicit Sparse Transformer):旨在解决自注意力机制提取不相关信息的问题,通过显式选择最相关片段,提高对全局上下文的注意力集中度,在自然语言处理和计算机视觉任务上具有性能优势。

多查询注意力(Multi - Query Attention):通过在所有不同的注意力 “头” 之间共享键和值,大幅减小张量大小,降低了增量解码的内存带宽需求,能更快解码且与基线相比质量下降轻微。

结构增强型 Transformer

Convolutional Transformers(Convs):在每一层之间嵌入一维卷积操作,结合了卷积神经网络的局部特征提取能力和 Transformer 的全局建模能力,有助于提高模型对局部信息的处理能力,增强模型的特征提取效果。

Gated Linear Units(GLUs):利用门控线性单元控制信息流路径,能够自适应地调节信息在模型中的流动,有助于提高模型的表达能力和训练效率。

Recurrent Neural Networks Integration:将 RNN 融入 Transformer 中,能够更好地捕捉时间依赖关系,适用于处理具有长期时间序列特征的数据,如语音和视频等。

基于 Transformer 架构的特定任务模型

ERNIE - Doc:一种基于递归 Transformer 的文档级语言预训练模型,通过回顾性馈送机制和增强的递归机制,能够捕获完整文档的上下文信息,具有更长的有效上下文长度,适用于文档级别的自然语言处理任务,如文档分类、文档摘要等。

CogView:一个具有 40 亿参数的 Transformer 模型,结合了 VQ - VAE 标记器,用于解决通用领域中的文本到图像生成问题,将自然语言处理与计算机视觉任务相结合,展示了 Transformer 在多模态任务中的应用潜力。

仅编码器架构(Encoder - only)

BERT(Bidirectional Encoder Representations from Transformers):通过使用掩码语言模型(MLM)和下一句预测(NSP)两种预训练任务,学习到双向的上下文信息,在多种自然语言处理任务上取得突破性成果,如文本分类、问答系统、命名实体识别等。

RoBERTa(Robustly Optimized BERT Pretraining Approach):是对 BERT 的改进,通过调整训练数据、训练策略等,进一步提高了模型的性能和泛化能力,在多个自然语言处理任务上取得了更好的效果。

仅解码器架构(Decoder - only)

GPT(Generative Pre - trained Transformer):通过预训练大量文本数据,学习到丰富的语言知识和生成模式,采用单向语言模型的预训练方式,根据已知前文预测下一个词,具有强大的文本生成能力,可生成新闻报道、故事创作、代码生成等高质量文本。

LLama(Large Language Model Meta):由 Meta 开发的大型语言模型,同样基于 Decoder - only 架构,在大规模预训练数据上进行训练,具有出色的文本生成能力和语言理解能力,可用于多种自然语言处理任务,如对话系统、文本生成、知识问答等。

生成对抗网络(Generative Adversarial Network, GAN)

简介:由伊恩・古德费洛等人在 2014 年提出,是一种生成式模型,通过对抗训练的方式学习数据的分布,从而生成新的数据样本。

结构:包含生成器和判别器两个部分。生成器的目标是生成与真实数据相似的样本,判别器的目标是区分生成的样本和真实样本,两者通过不断地对抗训练来提高各自的能力,最终达到一种平衡状态,使得生成器能够生成高质量的样本。

应用:在图像生成、图像编辑、数据增强、半监督学习等领域有广泛的应用,能够生成逼真的图像、视频等内容,也可以用于数据扩充和模型训练的辅助等。