MiniMind模型的web交互功能初试

MiniMind模型的web交互功能初试

一、前言

MiniMind提供了基于streamlit的web交互功能,能够即时切换模型和修改相关参数,经初步测试,具有比较好的体验感。本文介绍了使用MiniMind使用web交互功能的方法,并对使用中出现的问题给出了相应的解决方法。

二、测试模型准备

2.1、 模型下载

MiniMind已经训练好了多个模型,官网给出的模型下载地址为:

- PyTorch原生模型

- Transformers模型

可以从网站直接下载所需要的模型,也可以通过以下方式下载全部模型:

#SDK模型下载

from modelscope import snapshot_download

model_dir = snapshot_download('gongjy/MiniMind2-PyTorch')

#Git模型下载

git clone https://www.modelscope.cn/gongjy/MiniMind2-PyTorch.git

从官网给的Transformers模型下载链接看,MiniMind2目前只有PyTorch原生模型可以下载。

2.2、模型转换

MiniMind项目提供了通过streamlit实现了基本的web交互功能,程序为scripts目录里的web_demo.py。运行环境需要有streamlit,可以按如下方法安装:

pip install streamlit

然后启动网页对话程序:

streamlit run web_demo.py

很不幸,笔者运行的时候出现了以下错误提示:

ValueError: Unrecognized model in …/MiniMind2. Should have a

model_typekey in its config.json, or contain one of the following strings in its name: albert, align, altclip, aria, aria_text, audio-spectrogram-transformer, autoformer, aya_vision, bamba, bark, bart, beit, bert, bert-generation, big_bird, bigbird_pegasus, biogpt, bit, blenderbot, blenderbot-small, blip, blip-2, bloom, bridgetower, bros, camembert, canine, chameleon, chinese_clip, chinese_clip_vision_model, clap, clip, …

经检查程序,发现默认加载Transformers模型,直接把PyTorch模型放在模型路径下是不行的。因此需要使用scripts目录下的conver_model.py将PyTorch模型转换为Transformers模型。模型转换的相关参数按下表确定。

| Model Name | params | len_vocab | n_layers | d_model |

|---|---|---|---|---|

| MiniMind2-Small | 26M | 6400 | 8 | 512 |

| MiniMind2-MoE | 145M | 6400 | 8 | 640 |

| MiniMind2 | 104M | 6400 | 16 | 768 |

| minimind-v1-small | 26M | 6400 | 8 | 512 |

| minimind-v1-moe | 4×26M | 6400 | 8 | 512 |

| minimind-v1 | 108M | 6400 | 16 | 768 |

如对于MiniMind2-Small模型,参数和路径设置如下:

lm_config = LMConfig(dim=512, n_layers=8, max_seq_len=8192, use_moe=False)torch_path = f"../out/rlhf_{lm_config.dim}{'_moe' if lm_config.use_moe else ''}.pth"transformers_path = '../MiniMind2-Small'

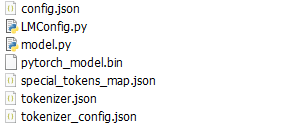

转换后,会在模型路径下生成以下文件,用于Transformers加载:

三、PyTorch原生模型的加载方式

除了上述PyTorch模型转换为Transformers模型的方法外,还可以直接修改web_demo.py直接加载PyTorch模型。

主要修改如下:

#...

MODEL_PATHS = {"MiniMind2-MoE (0.15B)": ["../MiniMind2-PyTorch", "MiniMind2-MoE"],

}

#...

def main():#model, tokenizer = load_model_tokenizer(model_path) # 注释掉此行model_file = f'{MODEL_PATHS[selected_model][0]}/full_sft_640_moe.pth'model = MiniMindLM(LMConfig(dim=640,n_layers=8,max_seq_len=6400,use_moe=True))state_dict = torch.load(model_file, map_location=device)model.load_state_dict({k: v for k, v in state_dict.items() if 'mask' not in k}, strict=True)model.eval().to(device)tokenizer = AutoTokenizer.from_pretrained('./model/minimind_tokenizer')

这样web_demo.py程序就可以正确加载PyTorch模型。

四、web交互测试

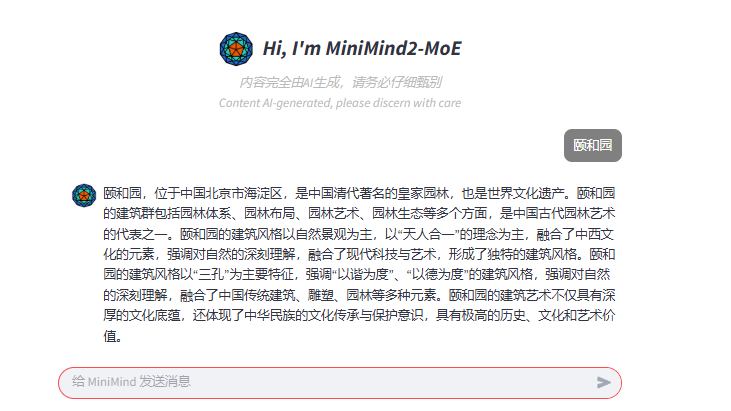

MiniMind2-MoE模型测试:

模型切换和参数设置:

推理模型MiniMind2-R1测试: